Сигналдардың информациялық-энтропиялық талдауы және күрделі жүйелердегі өзұқсастық пен тұрақты нүктелер

Нақтылы объектілер сыртқы ортамен энергиямен, затпен және информациямен алмаса алатын ашық жүйе болып табылады. Объектің тегіне тәуелсіз зерттелетін процес ықтималды құрылымда болса, оның симметриясы бұзылған кезде информация пайда болады. Екінші жағынан, табиғи құрылым - хаостан өз бетінше тәртіп орнау да - нақты бейсызық, ашық жүйелердің мейлінше жалпы даму заңдылығы. Информацияның және информациялық энтропияның физикалық аспектілерін қарастырайық.

Информация ұғымы. Информациялық энтропияЖалпы қабылданған терминологияға сәйкес информацияның келесі анықтамаларын қолданамыз.

«Информация» ұғымы әртүрлі мағынаға ие. Қоғамдық-саяси информация әлеуметтік жүйенің өзекті жаңалықтары туралы мәліметтердің жиыны болып табылады. Кибернетикада информация ұғымы сигналдарды сақтау, өңдеу және жіберумен байланысты. Ықтималдықтар теориясында информация аддитивті мөлшерлік өлшем ретінде кездейсоқ оқиғаларды бір-біріне қатысты ықтималдылығымен салыстыру арқылы енгізіледі. Барлық информация теориясы негізінде информацияны мөлшерлі бағалау жатыр. Қарапайым комбинаторикалық формада бұл тұжырымды Р. Хартли ұсынды, ал толық аяқталған түрін К. Шеннон тұжырымдады.

Шеннон информация теориясы О және L екі таңбаның арасындағы (биттер арасындағы) қарапайым альтернативті таңдаудан шығады, ондағы L 1-ге, “иә”, “шындық” т. с. с. теңестірілсе, ал О 0-ге, “жоқ”, “жалған” теңестіріледі. Мұндай таңдау екі белгіден тұратын хабарды қабылдауға сәйкес келеді.

Мұндай хабарда болатын информация мөлшері бірлік ретінде қабылданады және ол бит деп аталады. Сондықтан бит - екілік белгі және информация мөлшерінің өлшем бірлігі, ол екі байланысқан тең ықтималдықты таңдамадағы информация мөлшері ретінде анықталады.

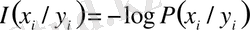

Айталық

(11)

(11)

-

Х

және

Y

әріптерімен сәйкес белгіленген жүйенің күйін сипаттайтын айнымалылар жыйыны болсын. Егер

-

Х

жүйесі

-

Х

жүйесі

күйде болғанда

Y

у

i

күйіне өту ықтималдығы (шартты ықтималдық) болса, онда

Y

жүйесінің алған информациясы мынаған тең:

күйде болғанда

Y

у

i

күйіне өту ықтималдығы (шартты ықтималдық) болса, онда

Y

жүйесінің алған информациясы мынаған тең:

. (12)

. (12)

-

X

жүйесіндегі

-

X

жүйесіндегі

оқиғасына қатысты

оқиғасына қатысты

информация мөлшері деп аталады.

информация мөлшері деп аталады.

Ықтималдық

арасында жатқандықтан

I

әрқашан оң шама.

арасында жатқандықтан

I

әрқашан оң шама.

Логарифм негізін таңдауға байланысты информация мөлшері екілік, ондық және натурал логарифм бойынша: сәйкесінше бит , дит , нат - пен өлшенеді.

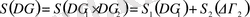

Статистикалық физикада энтропия ∆Г - жүйенің ішкі макроскопиялық күйінің статистикалық салмағының логарифмі ретінде енгізіледі:

, (13)

, (13)

мұндағы ∆p⋅∆q- фазалық көлем, ћ -Планк тұрақтысы, g -жүйенің еркіндік дәрежесінің саны. Классикалық физикада ћ қолданбайтындықтан энтропияны нақты анықтауға болмайды. (5) -ші формуланың түрі күрделі жүйенің энтропиясының аддитивтік талаптарынан шығады:

. (14)

. (14)

Идеал газдың энтропиясын (4) -ші формула бойынша есептей отырып (5) -ші формулаға келуге болады, мұндағы ∆Γ - идеал газдың қысымы, көлемі, температурасы бойынша анықталады.

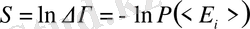

Энтропия түсінігі сонымен қатар кездейсоқ шамалардың ықтималдықтарының таралуына да байланысты. Е i энергияның теңықтималдықты таралуы кезінде жүйенің ішкі таралу ықтималдылығы былай анықталады.

.

.

Энтропияны мына түрде табамыз

. (15)

. (15)

Орташа ықтималдықтың мағынасы бойынша (15) былай жазылады:

(16)

(16)

(8) - бойынша анықталған энтропия информациялық энтропия деп аталады [8, 9] . (2) және (8) өрнектерін салыстыру арқылы информациялық энтропия информацияның орташа ықтималдық мәнін анықтайтындығы көрінеді. Жүйенің теңықтималды таралуы кезінде жүйе туралы анықталмағандық максимумге жетеді, яғни жүйе туралы барлық информация жоғалып энтропияға айналады (7) . Тепе-тең жүйе информацияны сақтай алмайды. Информацияны білу анықталмағандықты азайтады. Сондықтан информация мөлшерін жоғалған анықталмағандық, яғни энтропия мөлшерімен өлшеуге болады:

I = S pr - S ps ,

мұнда pr - индекс «априорлы» дегенді білдіреді (тәжірибеге дейін) ps «апостериорлы» (тәжірибеден кейін) . Осы себептен әдебиеттерде (16) -ші өрнекпен анықталатын шама кейде информация деп аталады( егер ол қабылданса), кейде энтропия деп аталады (егер ол жоғалса) . Осылайша Х шамасы туралы информация Ү берілген кезде мына теңдікпен анықталады.

I ( X ) = S ( X ) - S ( X/Y ) .

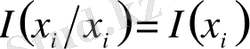

(16) -ші өрнектен энтропияның қасиеттері шығады:

- алдын-ала белгілі хабардың энтропиясы 0 -ге тең.

- барлық басқа жағдайлардаS >0 болады.

Жалпы қабылданған терминологияға сәйкес I i информациясы, P i ықтималдыққа ие құрылым пайда болғанда (жоғалғанда) (2) формуламен есептелінеді және келесі түрде табылады:

60

, (17)

, (17)

ал оның орта мәні - информациялық энтропия (8) -өрнекпен анықталады.

Әртүрлі иерархиялық деңгейлердегі өзұқсастық, өзқауымдық жүйелердің әмбебаптық қасиеттерінің бірі болып табылады. Олардың сипаттамасының масштабты инварианттылығы информацияның үздіксіз мәндерін қабылдауға мүмкіндік береді. Ал информацияны анықтаушы физикалық шама ретінде қабылдауға болады. Мұндай жағдайлар, алдымен күй функцияларының арасында (мысалы энергия мен энтропияның арасында) бірмәнді емес байланыс орнайтын күшті бейсызық динамикалы-информациялық жүйелерге (турбулентті орта, биологиялық объектілер т. б. ) қатысты.

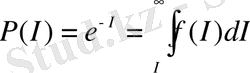

Сондықтан, информацияның байқалу ықтималдылығы жөнінде айтуға болады:

. (18)

. (18)

P ( I ) ықтималдықты f ( I ) ықтималдықтың таралу тығыздығының функциясы арқылы жазсақ:

, (19)

, (19)

мұндағы интеграл шектері

аймаққа сәйкес келеді. Демек,

аймаққа сәйкес келеді. Демек,

- информацияның байқалу ықтималдық функциясы

- информацияның байқалу ықтималдық функциясы

- ықтималдықтың таралу тығыздығының функциясымен сәйкес келеді. Информация күрделі жүйелердің барлық иерархиялық деңгейлерінің жалпы және толық сипаттамасы болып табылады: жүйенің бір бөлігі жалпы жүйе туралы мәліметті қамтиды.

- ықтималдықтың таралу тығыздығының функциясымен сәйкес келеді. Информация күрделі жүйелердің барлық иерархиялық деңгейлерінің жалпы және толық сипаттамасы болып табылады: жүйенің бір бөлігі жалпы жүйе туралы мәліметті қамтиды.

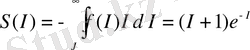

(18) формуланы ескере отырып, өзұқсас жүйелердің информациялық энтропиясын келесі түрде жазамыз:

. (20)

. (20)

үшін

үшін

және

және

болады.

болады.

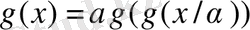

Өзқауымдық жүйенің өзұқсастығы қандай да бір сипаттамалы

функциясының мына функционалды теңдеуге сәйкестігімен сипатталады:

функциясының мына функционалды теңдеуге сәйкестігімен сипатталады:

, (21)

, (21)

мұндағы

α

- масштабты көбейткіш. Кез-келген үздіксіз функция өзінің қозғалмайтын нүктесінде (21) теңдеуді қанағаттандырады. Сипаттамалық функция ретінде

f

(

I

) - ықтималдық тығыздығын және

- информациялық энтропияны қабылдап, олардың қозғалмайтын нүктелерін табайық:

- информациялық энтропияны қабылдап, олардың қозғалмайтын нүктелерін табайық:

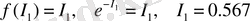

, (22)

, (22)

. (23)

. (23)

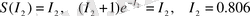

Бұл қозғалмайтын нүктелер бірмәнді орнықты, себебі олар, сонымен қатар, информацияның

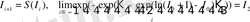

кез-келген бастапқы мәніне сай шексіз бейнелеудің шегі болып табылады:

кез-келген бастапқы мәніне сай шексіз бейнелеудің шегі болып табылады:

(24)

(24)

. (25)

. (25)

сандарының мағынасын әртүрлі түсіндіруге болады. Олардың ішіндегі ең әмбебабы - Фибоначчи санын (жүйенің динамикалық өлшемі - «алтын қима») қолдану аймағының кеңейуі.

сандарының мағынасын әртүрлі түсіндіруге болады. Олардың ішіндегі ең әмбебабы - Фибоначчи санын (жүйенің динамикалық өлшемі - «алтын қима») қолдану аймағының кеңейуі.

саны информациялық (локальді) сипаттауына, ал

саны информациялық (локальді) сипаттауына, ал

саны күрделі жүйені энтропиялық (орталанған) сипаттауға сәйкес келеді.

саны күрделі жүйені энтропиялық (орталанған) сипаттауға сәйкес келеді.

болса (22) -ден (21) шығады,

болса (22) -ден (21) шығады,

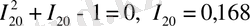

бойынша экспонентаны жіктеудің бірінші мүшесін ескерсек, онда (23) -ден

бойынша экспонентаны жіктеудің бірінші мүшесін ескерсек, онда (23) -ден

- Фибоначчи саны үшін теңдеу аламыз:

- Фибоначчи саны үшін теңдеу аламыз:

, (26)

, (26)

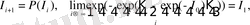

(21) теңдеуден I - I 10 = I 10 , I 10 = 0, 5.

Сонымен, тәжірибеде күрделі жүйенің өзқауым күйі S ∈[ I 20 I 2 ] жағдайда, қарапайым жүйенің өзұқсас жағдай I ∈[ I 10 , I 1 ] болғанда байқалуы тиіс.

Төменде (21), (22) тәуелділіктерді тұрғызуға арналған бағдарлама және сплайн интерполяцияның көмегімен тұрғызылған график келтірілген (3-сурет) .

I 1 , I 2 сандарының мағынасын жалпылама пайымдаулармен толығырақ ашуға болады. Шеннон бойынша Y берілген кездегі Х шамасы туралы информация шартсыз және шартты энтропиялардың айырымы ретінде анықталады:

... жалғасы- Іс жүргізу

- Автоматтандыру, Техника

- Алғашқы әскери дайындық

- Астрономия

- Ауыл шаруашылығы

- Банк ісі

- Бизнесті бағалау

- Биология

- Бухгалтерлік іс

- Валеология

- Ветеринария

- География

- Геология, Геофизика, Геодезия

- Дін

- Ет, сүт, шарап өнімдері

- Жалпы тарих

- Жер кадастрі, Жылжымайтын мүлік

- Журналистика

- Информатика

- Кеден ісі

- Маркетинг

- Математика, Геометрия

- Медицина

- Мемлекеттік басқару

- Менеджмент

- Мұнай, Газ

- Мұрағат ісі

- Мәдениеттану

- ОБЖ (Основы безопасности жизнедеятельности)

- Педагогика

- Полиграфия

- Психология

- Салық

- Саясаттану

- Сақтандыру

- Сертификаттау, стандарттау

- Социология, Демография

- Спорт

- Статистика

- Тілтану, Филология

- Тарихи тұлғалар

- Тау-кен ісі

- Транспорт

- Туризм

- Физика

- Философия

- Халықаралық қатынастар

- Химия

- Экология, Қоршаған ортаны қорғау

- Экономика

- Экономикалық география

- Электротехника

- Қазақстан тарихы

- Қаржы

- Құрылыс

- Құқық, Криминалистика

- Әдебиет

- Өнер, музыка

- Өнеркәсіп, Өндіріс

Қазақ тілінде жазылған рефераттар, курстық жұмыстар, дипломдық жұмыстар бойынша біздің қор #1 болып табылады.

Ақпарат

Қосымша

Email: info@stud.kz